生成AIの導入は、劇的な業務効率化をもたらす一方で、企業の信頼を一瞬で揺るがす多角的なリスクを孕んでいます。

現代の企業が備えるべきAIリスクには、自社がAIを「使う側」として引き起こすトラブルと、AIに「使われる側」として受ける風評被害があります。

この記事では、情報漏洩、著作権侵害、ハルシネーションといった実際に起こったAIトラブル事例を紹介します。

その上で、企業のブランドを守るためのガイドラインや、AIに学習させない技術制御、またネット風評被害対策である逆SEO・サジェスト対策まで、実務に即した具体的な対策を解説していきます。

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

CONTENTS

悪評リスクに、正しく対処するために。

企業の評判リスク対策を体系的に理解できる資料を無料公開。

悪評による影響や放置リスク、検索結果の仕組みから、具体的な対策方法と失敗しない進め方までをわかりやすく解説しています。

詳細ページ:https://webbr-lab.jp/whitepaper/

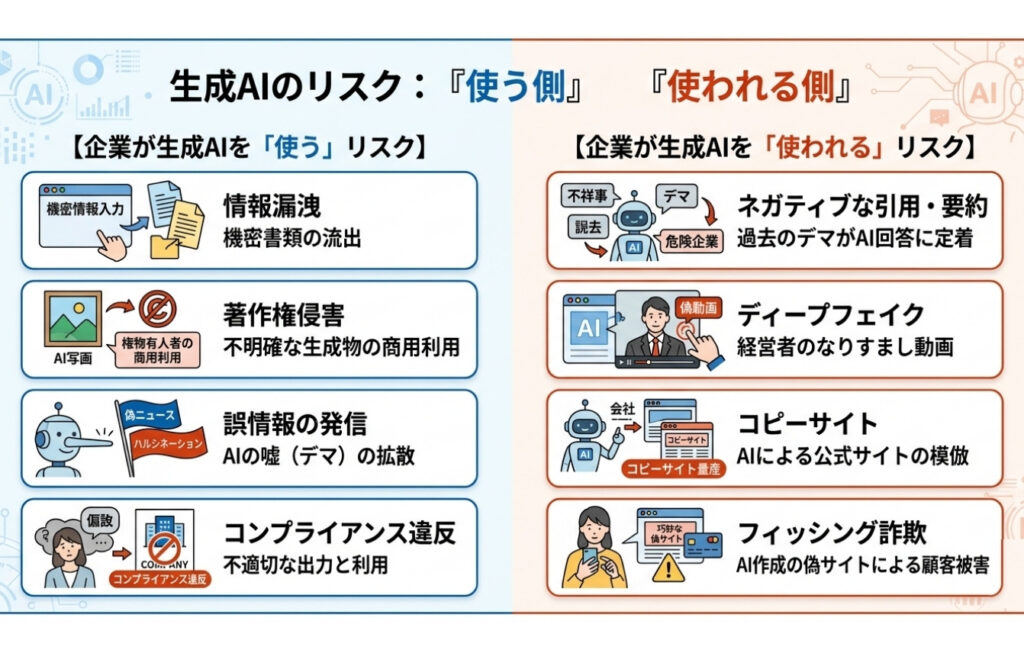

生成AIは「使う側」と「使われる側」、両方にリスクがある

企業が備えるべき生成AIリスクは「自社での利用」と「外部からの悪用」という2つの側面で構成されています。

企業が備えるべき生成AIリスクは「自社での利用」と「外部からの悪用」という2つの側面で構成されています。

生成AIを「使う側」と「使われる側」で想定される主なリスクは、以下の通り整理できます。

- 情報漏洩:プロンプトに機密情報を入力することによる流出

- 著作権侵害:権利関係が不明確な生成物の商用利用

- 誤情報の発信:AIがつく嘘(ハルシネーション)の拡散

- コンプライアンス違反:倫理的に問題のある内容の出力と利用

- ネガティブな引用・要約:過去の不祥事やデマがAI回答として定着

- ディープフェイク:経営者のなりすまし動画等による詐欺や信用失墜

- コピーサイト:AIによる公式サイトの模倣と量産

- フィッシング詐欺:AIで作成された巧妙な偽サイトによる顧客被害

本記事では、この「使う側」と「使われる側」の両面のリスクを紐解き、具体的な防御策について詳しく解説していきます。

悪評リスクに、正しく対処するために。

企業の評判リスク対策を体系的に理解できる資料を無料公開。

悪評による影響や放置リスク、検索結果の仕組みから、具体的な対策方法と失敗しない進め方までをわかりやすく解説しています。

詳細ページ:https://webbr-lab.jp/whitepaper/

企業が生成AIを「使う」場合のリスク

企業が生成AIを業務に導入する際は、「人為的なミス」と「技術的な限界」に起因する内部リスクを管理しなければなりません。

企業が生成AIを業務に導入する際は、「人為的なミス」と「技術的な限界」に起因する内部リスクを管理しなければなりません。

生産性の向上という大きなメリットがある反面、無防備な利用は企業のブランド価値や社会的信用を一瞬で失墜させるリスクを孕んでいます。

社内運用の徹底とリテラシー教育が不可欠となる具体的な4つのリスクを解説します。

- ハルシネーション(もっともらしい嘘)による誤情報の発信

- プロンプトへの機密情報入力による情報漏洩

- 生成物の商用利用による著作権・肖像権の侵害

- コンプライアンス・倫理観の欠如

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

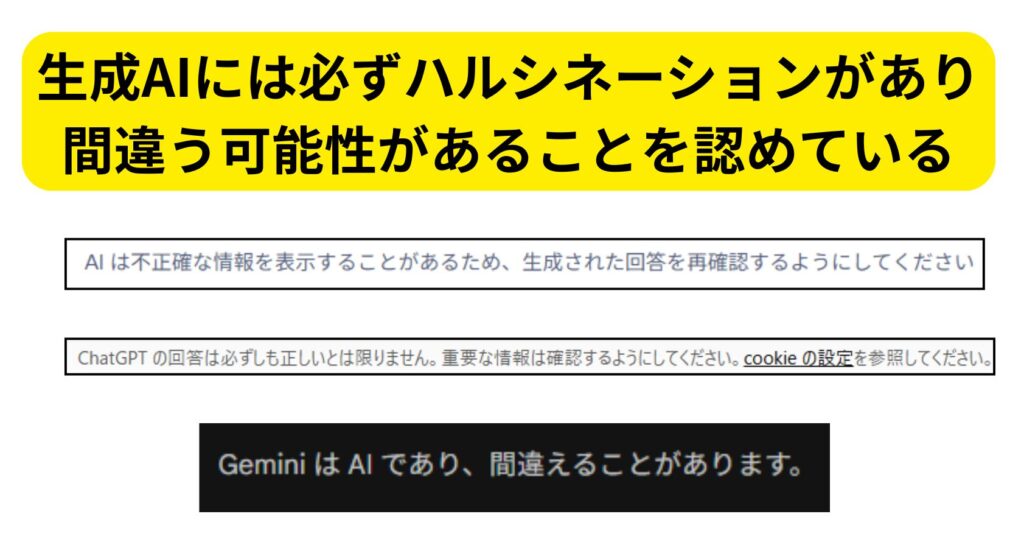

ハルシネーション(もっともらしい嘘)による誤情報の発信

※上から順にAI Overviews、ChatGPT、Geminiのハルシネーションへの注意書き

生成AIを利用する上で最も警戒すべきは、事実とは異なる情報をもっともらしく出力する「ハルシネーション」です。AIは膨大なデータから「次に来る確率が高い言葉」を選択して文章を構築しているに過ぎず、本質的に「真実かどうか」を判定する能力が弱いです。

主要なAIツールの提供元も、この技術的限界を明確に認めています。

もし企業がAIの回答を鵜呑みにして、存在しない法律や誤った製品仕様などを公式サイトで発信してしまえば、社会的信用の失墜は避けられません。

AI活用におけるファクトチェックは、決して省略してはいけない工程です。

プロンプトへの機密情報入力による情報漏洩

AIへの不用意なデータ入力は、企業の「機密情報」が外部へ流出する致命的なリスクとなります。これは多くの生成AIが、プロンプトに入力された情報をAIモデルの学習に利用する設定が標準となっているためです。

もし従業員がプログラムのソースコードや未公開の新規事業計画、あるいは顧客の個人情報を含む資料の要約をAIに依頼した場合、その内容はAIの知識ベースに蓄積されます。

そのため、法人向けプランによる学習拒否設定の活用や、入力可能な社内情報のガイドライン策定など、組織的な防衛策を講じることが急務となっています。

生成物の商用利用による著作権・肖像権の侵害

AI生成物の商用利用は、既存の「著作権」や「肖像権」を意図せず侵害し、多額の賠償請求や法的紛争に発展する深刻なリスクを孕んでいます。これは生成AIが、ネット上の膨大な著作物を学習しており、出力された画像や文章が特定の作品と「類似性」や「依拠性」を指摘されるケースが絶えないためです。

もし自社の販促物やWEBサイトにAI生成物をそのまま使用し、それが他者の権利を侵害した場合、それは広告の取り下げや損害賠償といった直接的なダメージだけでは治まりません。

コンプライアンス意識の低い企業というレッテルを貼られ、社会的信用を大きく損なうことになります。

コンプライアンス・倫理観の欠如

生成AIの利用は、法的な問題以前に、企業の「倫理的な姿勢」が問われることで深刻なブランド毀損を招くリスクを孕んでいます。特にクリエイティブな文化を支える業界において、安易に生成AI画像をPRに採用する行為は、ファンや関係者に対する敬意の欠如と見なされ、激しい批判を浴びるケースがあります。

たとえば、アニメイベントの告知ポスターにAI画像が使用された際、本来その文化を支えるはずのイラストレーターを軽視しているとして、SNS上で大きな物議を醸しました。

技術的に可能であっても、その業界の文脈や価値観に反する利用は、企業にとって致命的な炎上リスクとなります。

参照:ITmedia NEWS アニメファンの演奏家による「池袋アニメフィル」、AI生成画像利用で謝罪 高橋洋子さんが出演辞退

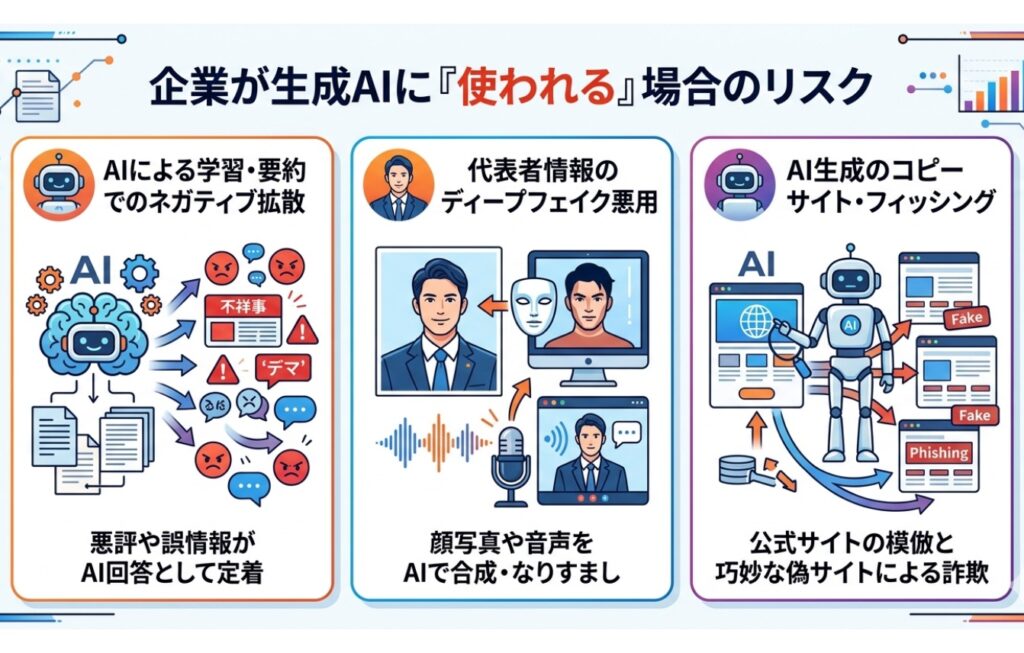

企業が生成AIに「使われる」場合のリスク

企業がどれほど「AIを使わない」と決めていても、インターネット上に自社の情報が存在する限り、第三者が運用するAIに「勝手に使われる」リスクは防げません。

企業がどれほど「AIを使わない」と決めていても、インターネット上に自社の情報が存在する限り、第三者が運用するAIに「勝手に使われる」リスクは防げません。

これはAIが、過去の情報を要約する過程で生じる意図せぬブランド毀損から、攻撃者がAIを直接武器にする悪質行為まで多岐にわたります。

企業のコントロールが及ばない領域で、生成AIに「使われる」3つのリスクを解説します。

- AIによる学習と要約でネガティブ情報の拡散

- 代表者の顔写真や音声の悪用・ディープフェイク被害

- AIによるコピーサイトやフィッシング詐欺

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

AIによる学習と要約でネガティブ情報の拡散

生成AIの要約回答において、過去の炎上事案や解決済みの不祥事が「現在の事実」のように要約され、ブランドイメージが毀損されるリスクがあります。従来の検索エンジンとは異なり、AIはネット上の情報を統合して一つの結論を生成するため、たとえ数年前の出来事であっても、それが現在の企業の特徴であるかのように提示される可能性があります。

特に過去の不祥事やネット上の批判記事などは、たとえ問題が解決し、公式な謝罪や改善が済んでいたとしても、ウェブ上にデータが残っている限り、AIはそれを参照することができます。

もし要約回答の中に、それらのネガティブな情報が回答表示されれば、ユーザーにとってはそれが事実のように映り、信用の失墜は避けられません。

また、ネガティブな回答が表示されなくても、「おすすめを教えて」というようなプロンプトにおいて、ネガティブな情報を学習したAIが、その企業やサービスを回答から避ける可能性もあります。

代表者の顔写真や音声の悪用・ディープフェイク被害

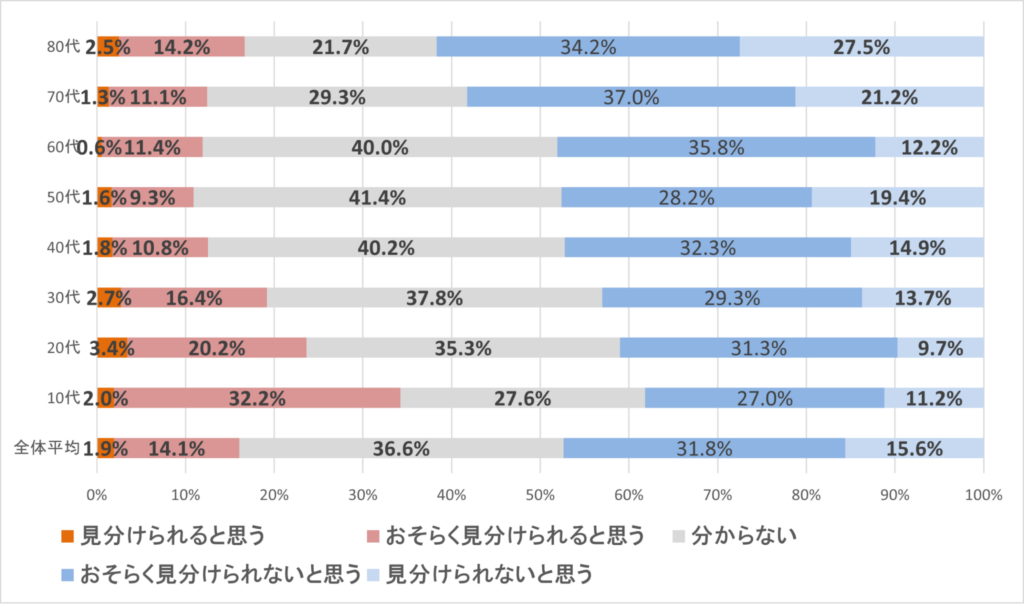

画像引用:トレンドマイクロ株式会社「ディープフェイクに関する国内実態調査2024」

生成AIの進化により、経営者や代表者の容姿・音声を精巧に模倣した「ディープフェイク」による被害が、企業にとって深刻な脅威となっています。ディープフェイクは、SNSやYouTubeに公開されている公式動画やインタビュー素材を悪用し、本人と見分けがつかない動画や音声を簡単に生成することが可能だからです。

トレンドマイクロ株式会社が実施した調査(18歳以上の男女2,585名対象)によれば、ディープフェイクを「見分けられると思う」と回答した人は、全体平均でわずか「1.9%」と、その技術が巧妙化していることが分かります。

具体的な被害としては、代表者の顔を借りた架空の投資詐欺や、実際には発言していない不適切な内容を語らせるデマの拡散などが挙げられます。

これらのコンテンツが拡散されると、株価の急落や社会的信用の失墜を招くだけでなく、詐欺に加担したと誤認した顧客や取引先との関係が悪化するリスクもあります。

本人が関与していないところで作成される「なりすましコンテンツ」は、一度拡散が始まると完全な消去は困難です。

AIによるコピーサイトやフィッシング詐欺

生成AIの悪用により、企業の公式サイトを精巧に模倣した「コピーサイト」や「フィッシングサイト」が大量生成されるリスクが急増しています。AIは既存サイトの構造やコンテンツを瞬時に解析し、似たようなものを複製することが可能なため、人間による手作業よりも遥かに高速で見分けのつかない偽サイトを構築できてしまいます。

これにより、顧客が個人情報を盗まれる詐欺被害だけでなく、検索エンジンがコピーサイトを誤認し、公式サイトの検索順位が下落するというSEO的な実害も考えられます。

自社のブランド名で検索した際に悪質なサイトが上位を占める状態は、企業の社会的信用を著しく損なう事態です。

悪評リスクに、正しく対処するために。

企業の評判リスク対策を体系的に理解できる資料を無料公開。

悪評による影響や放置リスク、検索結果の仕組みから、具体的な対策方法と失敗しない進め方までをわかりやすく解説しています。

詳細ページ:https://webbr-lab.jp/whitepaper/

生成AIを「使う」リスクを防ぐ社内対策

生成AIの利便性を享受しつつ、自社が「加害者」になるリスクを防ぐには、組織的な防衛体制の構築が不可欠です。

生成AIの利便性を享受しつつ、自社が「加害者」になるリスクを防ぐには、組織的な防衛体制の構築が不可欠です。

情報の取り扱いを個人の裁量に委ねるのではなく、明確な基準と教育によって人為的なミスを最小限に抑える必要があります。

生産性と安全性を両立させるために企業が取り組むべき社内対策として、以下の2点が挙げられます。

- AI利用ガイドライン・ルールの策定

- 従業員へのAIリテラシー教育

AI利用ガイドライン・ルールの策定

AIを業務で活用する際は、従業員それぞれの裁量に任せるのではなく、組織として統一された「AI利用ガイドライン」を明文化することがリスク回避につながります。情報の取り扱い基準が曖昧なままでは、意図しない情報漏洩や権利侵害を未然に防ぐことが困難だからです。

ガイドラインには、主に以下のような項目を盛り込みます。

| 利用可能ツールの指定 | 個人アカウントの使用を厳禁し、社内認証済みのツール使用を徹底する |

|---|---|

| 入力データの定義 | 個人情報や未公開の経営情報など、絶対に入力してはいけないデータの範囲を明確にする |

| 出力物の検証フロー | AI生成物を社外へ出す前に、著作権侵害や不適切表現がないかを確認する責任者を定める |

| 商用利用の制限 | プラットフォームごとの利用規約に基づき、営利目的での利用が許可されている範囲を規定する |

明確な基準を定めることで、企業の社会的信用を守りつつ、AIによる生産性向上を最大化することができます。

従業員へのAIリテラシー教育

ルールという壁を作るだけでは、隠れて私用アカウントを使う従業員の規約違反を防げません。教育を通じて、従業員一人ひとりが「なぜそのルールが必要なのか」というリスクの本質を理解し、主体的に判断できる力を養う必要があります。

具体的には、以下の視点でAIリテラシーを向上させます。

| 学習の仕組みを知る | 入力したデータがどのようにAIの糧となり、他者へ流出する恐れがあるのか、その技術的背景を学ぶ |

|---|---|

| 疑う力の醸成 | AIはもっともらしい嘘(ハルシネーション)をつく性質があることを前提に、一次情報にあたるファクトチェックを習慣化させる |

| 倫理感のアップデート | 技術的に可能であっても、業界の文脈やファンの感情を逆なでするような表現があることを理解する |

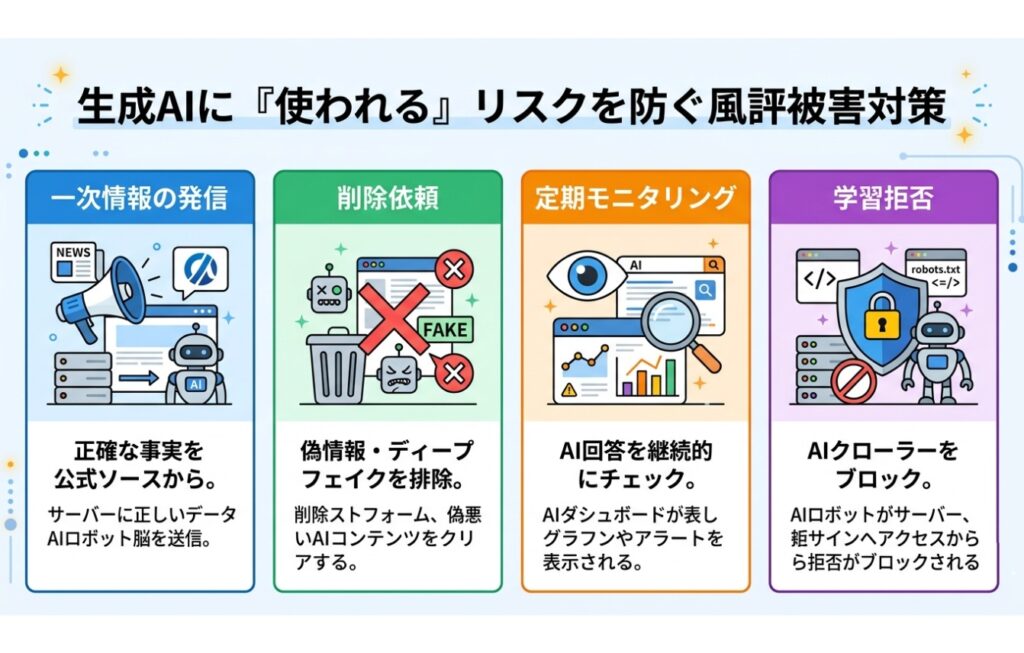

生成AIに「使われる」リスクを防ぐ風評被害対策

自社でAIを導入していなくとも、ネット上に公開されている情報は常にAIの学習対象となっています。

自社でAIを導入していなくとも、ネット上に公開されている情報は常にAIの学習対象となっています。

AIが誤った情報を要約したり、悪意ある第三者が生成AIを武器に攻撃を仕掛けてきたりする状況では、受け身の姿勢は命取りになりかねません。

自社がAIにどう見られているかを把握し、情報の出どころから制御する能動的な4つの風評被害対策を解説します。

- AIに正しい情報を学習させるための一次情報の発信

- 悪質な生成AIコンテンツ・フェイク動画の削除依頼

- AI回答の定期的なモニタリング

- AIクローラーの巡回ブロックと学習拒否

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

AIに正しい情報を学習させるための一次情報の発信

生成AIがハルシネーション(もっともらしい嘘)を起こす最大の要因は、参照元となる情報の不足や矛盾です。近年のAI検索エンジンは、回答の正確性を高めるために、信頼性の高い「一次情報」を優先的に参照し、引用元として提示する傾向が強くなっています。

企業側が沈黙を続ければ、AIはネット上の非公式な情報やSNSの噂、あるいは過去の古い記事を学習の根拠にしてしまいます。

これを防ぐには、自社に関する正しい最新の情報を公式サイトなどで能動的に発信し、AIが迷わず正しい情報を取得できる環境を整えることが重要です。

AIに正しく参照させるべき一次情報には、主に以下のようなものがあります。

- 公式サイトの会社概要・最新の取り組み

- プレスリリース・公式声明

- IR情報・事業報告書

- 製品・サービスの仕様

- 公式SNSでのリアルタイム発信

AI時代のブランド防衛策は、情報の消去よりも、正しい情報の上書きが重要となっています。

悪質な生成AIコンテンツ・フェイク動画の削除依頼

AIを悪用したディープフェイク動画や偽のコンテンツは、その精巧さゆえに拡散スピードが極めて速く、放置すればするほど「事実」として定着し誤解を生む恐れがあります。これらは単なる嫌がらせにとどまらず、代表者のなりすましによる投資詐欺や、根拠のない誹謗中傷など、企業の信用を揺るがす直接的な被害をもたらします。

被害を最小限に抑えるためには、法的措置を含めた迅速な初動対応が必要です。

- プラットフォームへの即時通報:SNSや動画共有サイト、検索エンジンの規約(なりすまし・著作権侵害)に基づき、運営側へ速やかに削除を要請する

- 「AIによる偽物」であることの注意喚起:削除が完了するまでの間、自社の公式サイトで「現在拡散されているコンテンツはAIによる偽物である」と公表し、顧客の二次被害を食い止める

- 法的根拠に基づく差し止め請求:名誉毀損や著作権侵害などとして、弁護士を通じてプロバイダ責任制限法に基づく送信防止措置を講じる

AIによる攻撃は深夜や休日を問わず、またたく間に拡散されます。

事態が発生してから「誰がプラットフォームに連絡するか」「どの弁護士に相談するか」と検討していては、AIの拡散スピードに追いつけません。

あらかじめ緊急時の連絡網や、削除依頼のテンプレート、公式サイトでの公表基準などを定型化しておくことで、有事の際でも冷静に対処することができます。

AI回答の定期的なモニタリング

生成AIが自社についてどのような回答を生成しているかは、実際に回答を引き出してみないと分かりません。AIに「どの情報を参照したか」「自社をどう評価しているか」を直接答えさせるプロンプトを活用し、定期的に回答の変遷をモニタリングする必要があります。

ここでは、以下の3つの視点でプロンプトを使い分け、AI回答の精度と引用状況を確認します。

| プロンプトの種類 | AI回答の精度と引用状況 |

|---|---|

| 引用元特定プロンプト | (社名・サービス名)について説明して。その際、回答の根拠としたウェブサイトのURLをすべてリストアップして。

|

| レピュテーション確認プロンプト | (業界名)において(自社名)はどのような強みと弱みがあると言われている?ネット上の評判を総合して、客観的な視点で箇条書きして。

|

| ハルシネーション検出プロンプト | (自社名)の(特定の不祥事や過去のニュース)の現状について教えて。

|

このようなプロンプトによる回答出力を定期的に実行し、もし誤った情報や古いネガティブ情報が優先的に回答される傾向があれば、一次情報の更新や検索結果の浄化対策(逆SEO)を講じる必要があります。

AI時代のネット風評被害対策は、検索結果だけでなく、AIの要約回答を通したアウトプットまで監視し続けることが必要になっています。

AIクローラーの巡回ブロックと学習拒否

自社のコンテンツが無断でAIの学習データとして利用されたり、AI検索エンジンに意図しない形でインデックスされたりすることを防ぐためには、技術的な手段による遮断が有効です。多くの生成AIは「クローラー」と呼ばれる自動収集プログラムを使用してネット上の情報を収集していますが、これらはウェブサイト側の設定で拒否することが可能です。

具体的な対策として、以下の手法が挙げられます。

| AIクローラーの巡回ブロックと学習拒否の手段 | 内容 |

|---|---|

| robots.txtによる拒否設定 | サーバー上の「robots.txt」ファイルに、特定のAIクローラー(OpenAIの「GPTBot」やGoogleの「Google-Extended」など)のアクセスを禁止する記述を加える。

これにより、将来のAIモデルの学習データから自社サイトを除外するよう促せます。 |

| 「noindex」タグの活用 | AI検索結果に特定のページを表示させたくない場合、HTMLにnoindexタグを挿入することで、検索エンジンのインデックス対象から外すことができます。

|

| 学習利用のオプトアウト申請 | 各AIプラットフォームが提供しているデータ利用の拒否設定(オプトアウト)や申請フォームを利用し、自社データが学習に利用されないよう個別に手続きを行います。

|

「守りたい秘匿性の高いページ」と「広めたい公開情報」を切り分け、戦略的にブロック範囲を指定する柔軟なサイト運営が求められます。

生成AIのプロンプトに入力してはいけない情報とは?

基本的には、生成AIのプロンプトには、「すでに世の中に公開されている情報」以外は入力しないのが鉄則です。

基本的には、生成AIのプロンプトには、「すでに世の中に公開されている情報」以外は入力しないのが鉄則です。

一度入力されたデータはAIの学習に利用され、第三者への回答として意図せず流出するリスクが生まれてしまいます。

具体的に、企業が生成AIのプロンプトに入力すべきではない情報には、以下のようなものがあります。

| 生成AIのプロンプトに入力してはいけない情報 | 内容 |

|---|---|

| 個人情報 | 氏名、住所、メールアドレスなど

|

| 社外秘の機密情報 | 未発表の企画、会議の議事録、財務データなど

|

| 顧客・取引先情報 | 契約内容、商談メモ、プロジェクト詳細

|

| 自社独自のソースコード | 脆弱性やアルゴリズムの流出に繋がる

|

| ID・パスワード | サーバー設定やログイン情報など

|

| インサイダー情報 | 未公開の提携先や合併に関する情報など

|

「ちょっと要約するだけ」という一時の油断が、社会的信用を失墜させる致命的な引き金になります。

これらの入力してはいけない情報を、社内ガイドラインに組み込んで共有化することが重要です。

実際に起きた生成AIの企業リスク・トラブル事例5選

生成AIの普及に伴い、すでに世界中では数多くのトラブルや法的紛争が発生しています。

生成AIの普及に伴い、すでに世界中では数多くのトラブルや法的紛争が発生しています。

これらの事例を見ていくと、自社が主体となってAIを「使うリスク」と、自社や権利者のデータが外部のAIに「使われるリスク」の2つに大別できることが分かります。

今回紹介する6つの事例を、それぞれの属性に分類すると以下の通りです。

- 【情報漏洩】大手メーカー従業員による機密コード入力

- 【ハルシネーション】航空会社のAIチャットボットによる架空ルール案内

- 【ハルシネーション】弁護士による架空判例の提出

- 【倫理観・炎上】ペンタブ会社によるPRへのAI画像使用

- 【著作権侵害】ニューヨーク・タイムズによる提訴

- 【ディープフェイク】実在する経営者の偽動画による投資詐欺

以下、ご紹介する事例に関して、

当社は、関係性もとい、ご紹介している事例におけるいかなる関与もしておりません。以下の内容について一切の責任を負いません。内容に関するご質問やご対応はできかねますので、あらかじめご了承ください。

【情報漏洩事例】従業員によるChatGPTへの機密コード入力

サムスン電子で発生したこのトラブルは、AIの情報漏洩リスクを世界に知らしめる象徴的な事例となりました。2023年4月、同社の半導体部門において、エンジニアが業務効率化のためにChatGPTへ機密情報を入力したことが発覚しました。

具体的には、設備計測用プログラムやのソースコードを丸ごと貼り付けて修正を依頼したり、スマートフォンで録音した会議内容を元にAIに議事録を作成させたりしていたことが判明しました。

一度入力されたプロンプトは外部サーバーに保存され、AIの学習データとして蓄積されるため、企業側が後から回収・削除することは不可能です。

この事態を受け、同社は社内ネットワークでの生成AI利用を原則禁止とする厳しいポリシーを策定することになりました。

- 【この事例から学ぶべきポイント】

- なぜ発生したのか:現場の業務を効率化したいという善意が、セキュリティ意識を上回ったため

- リスクの実害:競争力の源泉である独自のソースコードやノウハウが、競合へ渡るリスクが生じた

- 具体的な防衛策:「AIへの入力=全世界への公開」という認識の徹底。特定のツールの使用禁止など物理的な遮断が必要

参照:ライブドアニュース SamsungのエンジニアがChatGPTに社外秘のソースコードを貼り付けるセキュリティ事案が発生

参照:Ledge.ai サムスンが従業員のChatGPT利用を禁止、機密データ漏洩で

【ハルシネーション事例】航空会社のAIチャットボットの架空のルール案内

カナダの大手航空会社エア・カナダが、自社サイトに導入した生成AIチャットボットのハルシネーションによって乗客から訴えられ、敗訴した事例です。事の発端は、ある乗客が親族の葬儀のために、忌引割引の適用を求めてチャットボットに質問したことでした。

AIチャットボットは「購入日から、90日以内であれば差額の払い戻しを申請できる」という存在しない架空のルールを回答しました。

しかし、実際の規定では「払い戻しは不可」となっており、返金を拒否された乗客が提訴する事態となりました。

裁判において、同社は「チャットボット自体に責任がある」という主張を展開しましたが、裁判所はこれを一蹴しました。

AIの回答も会社公式の情報であるとの判断が下され、エア・カナダは損害賠償と裁判費用の支払いを命じられることになりました。

- なぜ発生したのか:AIが根拠となる規約を正確に参照せず、ハルシネーションを生成したため

- リスクの実害:裁判所による賠償命令に加え、ブランドイメージが大きく失墜

- 具体的な防衛策:AI出力に対する企業責任を自覚した運用体制の構築

参照:EnterpriseZine カナダ大手航空会社が生成AIの“でたらめ回答”で敗訴

【ハルシネーション事例】弁護士が生成AIで作成した架空の判例を裁判所に提出

2023年5月、ニューヨークの弁護士が裁判資料の作成にChatGPTを使用し、存在しない架空の判例を引用した資料を提出したことで、懲戒処分の危機に追い込まれた事例です。問題が起きたのは、アビアンカ航空を相手取った民事訴訟でした。

担当弁護士は、自身の主張を裏付けるためにChatGPTを使って過去の判例を調査し、それらを裁判所に提出しました。

しかし、裁判官が提出された判例を調べたところ、デルタ航空やユナイテッド航空などが関わっているとされる計6件の判例が、実際にはこの世に存在しないハルシネーションであることが発覚しました。

驚くべきことに、この弁護士はAIの回答に疑いを持ち、ChatGPTに対してファクトチェックの再確認まで行っていました。

しかし、AIがまた嘘をついたことで、弁護士はそれを真実だと思い込み、裏付け調査を怠ったまま提出することになりました。

裁判官は前代未聞の事態として、弁護士を厳しく批判し、司法の信頼性を揺るがす重大な過失として、世界中のAI利用者に衝撃を与えました。

- なぜ発生したのか:ハルシネーションの性質を理解していなかったため。また、AI自身にファクトチェックさせ信用してしまったため

- リスクの実害:弁護士としての信用失墜だけでなく、懲戒処分の対象となり、キャリアに致命的なダメージを負った

- 具体的な防衛策:必ず一次情報(公式なデータベースや書籍など)で裏取りを行うこと

参照:日本経済新聞 ChatGPTで資料作成、実在しない判例引用 米国の弁護士

【倫理観・炎上事例】ペンタブ会社がPRに生成AI画像を使用し謝罪

クリエイター向けのペンタブレットで世界シェアを誇るワコム(Wacom)が、プロモーションに「生成AIで作られた疑いのある画像」を使用したとして、国内外のアーティストから猛反発を受け、謝罪に追い込まれた事例です。2024年1月、同社の米国支社が新年のセール告知としてX(旧Twitter)に投稿した龍のイラストに対し、多くのユーザーから「生成AI特有の違和感がある」との指摘が相次ぎました。

ワコム側は当初、AI生成ではないことを確認済みであるとして、AI検出ツールも使用してチェックしたことを公表しました。

しかし、クリエイターを顧客とする企業が、安易にAI生成物、もしくはその疑いがある画像を使用したことに対し、「リスペクトがない」といった批判が殺到し炎上しました。

最終的に同社は、制作プロセスの完全な遡及は困難であると判断し、該当の投稿を削除。

イラストの使用を中止するとともに、今後の画像選定プロセスを抜本的に見直すと表明しました。

- なぜ発生したのか:クリエイターが抱くAI生成物に対する倫理的懸念や反発を過小評価していたため

- リスクの実害:最大の顧客層であるプロ・アマチュアのアーティストからの信頼を大きく毀損

- 具体的な防衛策:コンテンツのガイドラインの策定。制作の透明性を確保し、ブランドに矛盾しない素材選びの徹底

参照:ITmedia NEWS ワコムの広告にAIイラスト? クリエイターから反発の声殺到 同社が経緯を説明する事態に

【著作権侵害事例】ニューヨークタイムズが記事の無断学習をAI企業に提訴

ニューヨーク・タイムズ(以下、NYT)が、生成AIを用いた検索サービスを提供する「Perplexity」を相手取り、著作権侵害で提訴した事例です。2025年12月、NYTは自社の記事や動画などのコンテンツが、「Perplexity」のAI検索エンジンによって無断で取得・利用されているとして、著作権侵害行為の差し止めと損害賠償を求めて提訴しました。

NYTは、AIが有料会員向けのコンテンツを無断でクロールしているだけでなく、ハルシネーションの誤情報によってブランドを傷つけていると主張しました。

同社に対し何度もコンテンツ使用の停止を求めたものの、改善されなかったことが提訴の決め手となりました。

「Perplexity」をめぐっては、日本でも読売新聞社や日本経済新聞、朝日新聞などの主要メディアが相次いで提訴しており、AI企業による「情報のタダ乗り」が問題視されている。

- なぜ発生したのか:AI企業が、著作権を無視したデータの自動取得を強行したため

- リスクの実害:有料購読者のみに提供すべき独自記事が無料で消費されることによる収益源。ハルシネーションによるブランド毀損

- 具体的な防衛策:出版社側は技術的なブロックだけでなく、法的なライセンス契約の締結を求める必要も考えられる

参照:日本経済新聞 NYタイムズ、米AI新興パープレキシティを提訴 著作権侵害で

【ディープフェイク事例】実在する経営者の偽動画・偽音声による投資詐欺

実業家の前澤友作氏や、同氏が手がけるサービス「カブアンド」の名前を騙り、AIで生成した偽の動画や音声を使って投資を勧誘する悪質な広告がSNS上で急増した事例です。2024年以降、InstagramなどのSNSにおいて、前澤氏本人が話しているかのように精巧に作られた「ディープフェイク動画」が多数確認されました。

これらは、同氏の過去のメディア出演映像や音声をAIに学習させたもので、ありもしない投資案件や高額リターンをうたい、個人情報や金銭をだまし取ることを目的としたものでした。

前澤氏は、これらの広告が完全な詐欺であると、強く注意喚起を行いました。

SNS各社へ削除要請をするものの、すぐに新しい偽広告が出稿される「いたちごっこ」となり、対応が不十分であるとして、同氏はMeta社に訴訟を提起するなど、異例の事態に発展しました。

- なぜ発生したのか:生成AI技術の向上により、有名人の顔や声を高精度に複製できるようになったため

- リスクの実害:著名人個人のパブリシティ権の侵害や、ブランドイメージの毀損。法的措置に伴うコストと労力の発生

- 具体的な防衛策:偽情報の通報、公式認証マークの活用、被害発生時の迅速な法的対応の整備

参照:カブアンド 前澤やカブアンドを騙る「偽の動画広告」について注意喚起とお願い

生成AIによるネット炎上を抑える対策

生成AIによる炎上を鎮静化させるには「迅速な初動対応」と「検索エンジンの最適化」を行う必要があります。

生成AIによる炎上を鎮静化させるには「迅速な初動対応」と「検索エンジンの最適化」を行う必要があります。

ハルシネーションやフェイク動画による誤情報は、放置するほどブランドイメージを傷つける風評被害リスクがあるため、早めの対処が必要です。

誠実なコミュニケーションと技術的な抑制を組み合わせて、ネガティブな情報をコントロールする対策が求められます。

- 事実関係の確認と公式声明の発信

- 逆SEO対策によるAI炎上記事の押し下げ

- サジェスト対策による「AI」「炎上」等の浄化

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

事実関係の確認と公式声明の発信

生成AIに起因するネット炎上を抑えるためには、事実関係の確認と透明性の高い公式声明の発信です。AIによるハルシネーションやディープフェイクによる刺激的な情報は、拡散のスピードが速く、放置するほど事実として定着してしまうリスクがあります。

具体的な対応の流れは、以下の通りです。

- 拡散されている内容が自社の不備によるものか、第三者による悪質なものかを特定

- 調査の全容解明を待たず、現時点での公式な見解を公表して憶測の連鎖を断つ

- 誤情報が判明したものに関しては「事実と異なる」ことを逐一発信し、正しい情報を提示

不確かな情報が、AIの回答として定着する前に、企業自らが正しい情報を定義し、発信し続ける姿勢が重要です。

逆SEO対策によるAI炎上記事の押し下げ

逆SEO対策とは、特定のネガティブな記事を消去するのではなく、他の健全なサイトの順位を上げることで、相対的に検索結果の下位へ「押し下げる」手法のことです。生成AIによるハルシネーションや炎上記事が一度拡散されると、情報の完全な削除は極めて困難なため、この物理的に露出を抑制することが有効な対策となります。

逆SEOの具体的な対策は以下の通りです。

- 公式サイトや公式SNSのSEOを強化し、検索結果の最上位を自社情報で占有

- 信頼性の高い大手メディアへプレスリリースを配信し、検索上位に正しい事実を配置

- 関連性の高い特設サイトやブログを複数構築し、ネガティブな記事を2ページ目以降へ追いやる

サジェスト対策による「AI」「炎上」等の浄化

サジェスト対策とは、検索エンジンでキーワードを入力した際に表示される検索候補(サジェスト)から、不適切なワードを排除しクリーンな状態に整える施策です。生成AIによるトラブルや誤情報が拡散されると、検索窓に「社名 + 炎上」や「社名 + AI」といったネガティブな言葉が並ぶ「サジェスト汚染」が発生することがあります。

これを放置すれば、社名検索をする人の多くが初めにネガティブな情報に触れることになり、深刻な風評被害を招くため早期の対応が必要です。

サジェスト対策の具体的な対策は以下の通りです。

- 検索エンジン各社に対し、ポリシー違反に基づいた不適切な検索候補の削除申請をする

- 「社名 + サービス名」や「社名 + 事例」といった、健全なキーワードが表示されるように情報発信をコントロールする

- SNSやプレスリリースなどを戦略的に活用し、ブランドイメージを向上させるサジェストを積極的に創出する

企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

企業が生成AIを導入する際のよくある質問(FAQ)

生成AIの導入を検討する企業にとって、セキュリティや著作権などに関する疑問は尽きません。特に機密保持の仕組みや運用ルールについては、導入前に明確な回答を持っておく必要があります。

ここでは、ビジネス現場の具体的な質問に対して、実務に即した解説を行います。

- QGemini for Google Workspaceって情報漏洩しないの?A「Gemini for Google Workspace」は、法人利用を前提とした厳格なデータ保護体制を構築しており、通常の利用で機密情報が外部に漏洩することはありません。

Googleが公式に提示しているプライバシー制御の概要によると、入力したプロンプトやWorkspace内のコンテンツが、許可なく生成AIモデルのトレーニングに使用されることは「ない」と明記されています。

具体的な保護の仕組みは以下の通りです。- プロンプトや生成された回答が、他のユーザーや組織と共有されることはない

- ユーザーにアクセス権限がないWorkspace内のコンテンツに、AIが勝手にアクセスすることはない

- 生成された回答をメールやドキュメントに挿入する際は、既存のデータ保護管理が自動的に適用される

- ユーザーのプロンプトや関連するコンテキストは、あくまで「回答を生成するため」にのみ使用される

参照:Google Workspace の生成 AI に関するプライバシー ハブ

このように、企業が持つ情報資産は高度なセキュリティ下で管理されるため、ビジネスシーンでも安心して導入することが可能です。

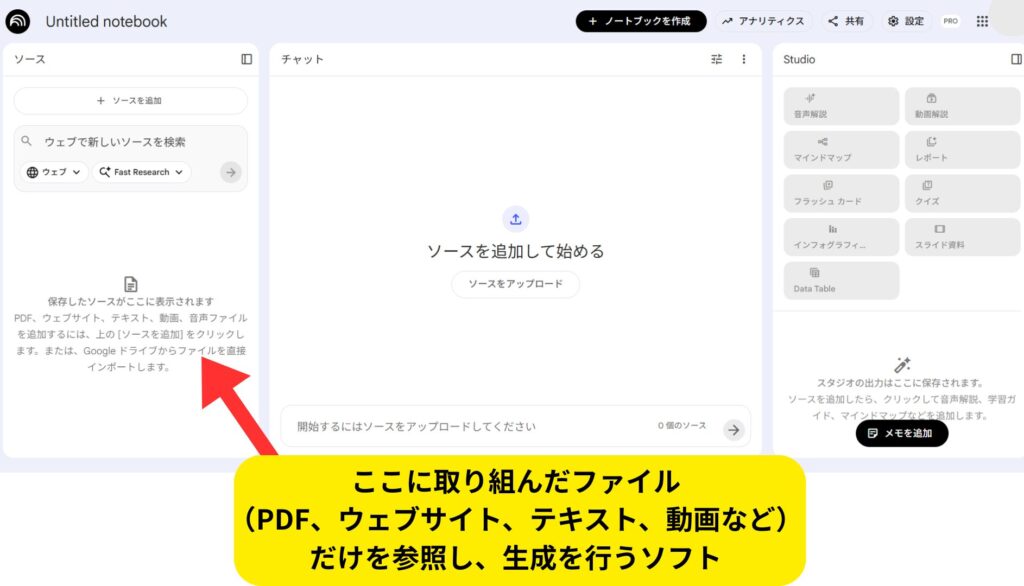

- Q著作権を侵害せずに生成AIを活用するには?A

著作権侵害を防ぐ最も確実な方法は、生成の根拠となる資料を自分自身で用意したソースに限定することです。

著作権侵害を防ぐ最も確実な方法は、生成の根拠となる資料を自分自身で用意したソースに限定することです。

一般的なAIはネット上の膨大なデータを学習していますが、これでは意図せず他者の著作物に「依拠」してしまうリスクが残ります。

この課題を解決するのが、Googleの「NotebookLM」というツールです。

上の図のように、ユーザーが自らアップロードしたPDF、ウェブサイト、動画などのファイルだけを参照してAI生成を行うことができます。

AIの参照先を自分が管理する情報に限定できるこのツールは、著作権保護とAI活用を両立させる強力な手段となります。

- QChatGPTに学習させたくない場合はどうする?AWebサイトの情報をAIに勝手に学習させないためには、技術的な巡回ブロックとインデックス拒否の設定が有効です。

AI各社はクローラーを使用して、ネット上の情報を収集しているため、これらを物理的に遮断する対策が必要となります。

具体的なAI学習の回避手段は以下の通りです。- 「robots.txt」ファイルにAI専用のクローラー(GPTBot等)を拒否する記述を追加する

- 「noindex」メタタグをページ内に設置し、AIや検索エンジンに情報を登録させない意思表示をする

- GoogleのAI要約(AI Overviews)に引用されたくない場合は、「nosnippet」タグを活用して制御する

- 各AI開発元が提供する「オプトアウト申請フォーム」から、自社ドメインを学習対象から除外するよう直接依頼する

- Qハルシネーションを防ぐ方法はある?Aハルシネーションは、AIの性質上完全になくすことは不可能ですが、リスクを最小限に抑える方法はあります。

「使う側」はAIの挙動を制御し、「使われる側」はAIに正しい情報を参照させるための工夫が求められます。【使う側の対策】- 「NotebookLM」などを活用し、AIの参照元を自分が用意した信頼できる一次資料のみに限定する

- プロンプトに「根拠がない場合は回答を控える」という制約を加え、AIの勝手な推測を封じる。(ただしこれでも無理な場合はある)

- 最終的な出力物は必ず人間が元のソースと照らし合わせる「ファクトチェック」を徹底します

【使われる側の対策】- AIが情報を誤解なく読み取れるよう、公式サイトに構造化データを用いた一次情報を正しく整備する

- 誤った要約があれば、「robots.txt」ファイル「noindex」メタタグ「nosnippet」タグなどを活用し、技術的に制限する

まとめ:生成AIには「使う」「使われる」両方のリスクマネジメントが必要

生成AI時代における企業の信頼保護には、自社がAIを「使う側」としての内部統制と、AIに「使われる側」としての外部対策を、両立させることが求められます。

「使う側」には、情報漏洩、権利侵害を防ぐための、社内ガイドラインや運用フローの管理を徹底することが重要です。

また、「使われる側」には、ハルシネーションやディープフェイクといったコントロールできないリスクを、技術的なブロックや、逆SEO・サジェスト対策といったリスクを最小限に抑える防衛策が必要です。

AIの利便性を享受しながらも、常に最悪の事態を想定したリスクマネジメントをすることが、企業のブランド価値の維持に直結します。企業リスクを今すぐ解決!逆SEOとサジェスト対策に特化した実績で、貴社のブランドを守るアクシアカンパニー。過去1200件以上の成功事例と業界トップクラスの成果を誇ります。売上・採用・ブランドを守るための最適解を提供している専門会社です。

PR 「サジェスト/関連ワードを非表示に」 非表示率99%のサジェスト汚染対策はこちら

悪評リスクに、正しく対処するために。

企業の評判リスク対策を体系的に理解できる資料を無料公開。

悪評による影響や放置リスク、検索結果の仕組みから、具体的な対策方法と失敗しない進め方までをわかりやすく解説しています。

詳細ページ:https://webbr-lab.jp/whitepaper/無料の風評被害対策ガイド資料ダウンロードはこちら

風評被害対策会社比較表

| イメージ |  引用元:https://axia-company.co.jp/ 引用元:https://axia-company.co.jp/ |  引用元:https://zeal-c.jp/ 引用元:https://zeal-c.jp/ |  引用元:https://www.siemple.co.jp/ 引用元:https://www.siemple.co.jp/ |  引用元:https://www.roadmap.co.jp/ 引用元:https://www.roadmap.co.jp/ |  引用元:https://solution.brandcloud.co.jp/ 引用元:https://solution.brandcloud.co.jp/ |  引用元:https://net-fuhyohigai-taisaku.co.jp/ 引用元:https://net-fuhyohigai-taisaku.co.jp/ |  引用元:https://blitz-marketing.co.jp/ 引用元:https://blitz-marketing.co.jp/ |

| 会社名 | アクシアカンパニー | ジールコミュニケーションズ | シエンプレ | ロードマップ | ブランドクラウド | ネット風評被害対策 | BLITZ Marketing |

| 企業概要 | 逆SEOとサジェスト対策に特化し、業界トップクラスの成功率を実現する実力派企業。 | デジタルリスク対策の専門企業として15年以上の実績、豊富な危機対応力で高く評価 | デジタル・クライシス対策のパイオニアとして一貫して支援できる点が強み | 自社一貫対応で誹謗中傷・炎上・サイバーリスクにワンストップ対応 | 20年以上のノウハウに基づき、多くの企業支援(具体件数・企業名は非公開) | 10年以上の豊富な実績と、独自開発AIを活用した24時間365日体制をしている | SEO、広告、レピュテーション対策をワンストップで提供。 |

| おすすめポイント | ・スピーディーかつ効果的なネガティブ対策が必要な企業・個人に最適 ・リスクを"抑えるだけ"でなく、"好印象を育てる"戦略にも対応 ・リアルタイム監視と自社メディアでPRが可能 | ・リスク発生前の体制づくりから社内教育 ・幅広くサポートを受けたい企業に最適 ・スピーディーな対応と柔軟な対策も魅力 | ・リスク管理と同時にブランド価値向上を図りたい企業に最適 ・マーケティング戦略も一貫して任せられる ・警察庁受託実績を持つ信頼性の高さ | ・サイバー攻撃や反社リスクもまとめて対応 ・自社一貫体制でスピード対応 ・逆SEO・MEO・サイバーセキュリティに精通した専門人材がいる | ・ブランド価値の本質的な保護を重視 ・金融・政治・教育などリスク管理が厳しい分野に最適 ・経営施策レベルでの支援を求める企業におすすめ | ・悪評リスクに迅速に対応したい企業・個人に最適 ・24時間監視とAI検知 ・即応力とトータルサポートが魅力 | ・10年以上のデジタルマーケティング実績 ・ブランド力を高めながら売上向上も目指したい企業に最適 ・課題に合わせたオーダーメイド施策と迅速な対応力 |

| 実績 | 取引実績1200社以上 逆SEO成功率85%以上 サジェスト非表示成功率99%以上 | 取引実績4,200社以上 | 累計8,000社以上 | 累計200件以上(SEO/MEO/逆SEO等)、サイバー攻撃対応400件以上 | サービス導入企業数400社以上 リスク対策成功率94% 対策実績年数10年以上 | 公式には非公開(10年以上の経験・多数対応実績あり) | 創業10年以上、幅広い業種・業界に対応(具体件数・企業名は非公開) |

| 対応範囲 | Google / Yahoo! / Bing | 炎上対策、SNS監視、誹謗中傷対応、社内研修、ガイドライン策定支援 | SNS/口コミ監視、逆SEO、誹謗中傷対策、サイレントクレーム対策、Webマーケティング支援 | 誹謗中傷削除、逆SEO、サジェスト削除、サイト改ざん対応、フォレンジック調査、信用調査(反社チェック等) | 誹謗中傷投稿削除、発信者情報開示請求支援、逆SEO、レピュテーションモニタリング | サジェスト対策、口コミサイト・掲示板対応、AIによるWEBリスク検知 | Webマーケティング、ブランド価値向上支援、逆SEO対策、広告運用最適化 |

| 対応スピード | 調査から見積提示まで最短即日 | 迅速対応 | 火種検知・迅速対応 | 迅速なサービス提供が可能 | 明示なし | 24時間365日体制でWEB・SNSリスクを監視 | 案件ごとにスピーディな対応 |

| 逆SEO価格帯 | 月額5万円〜(個人名対策) 月額10万円〜(法人名対策) 月額10万円〜(サービス名) | 案件規模・内容により個別見積 | 要問合せ | 内容・規模により個別見積 | 案件ごとにより異なる | 案件内容に応じて個別見積 | 案件内容に応じて個別見積 |

| サジェスト対策価格帯 | Googleサジェスト 50,000円~ Yahoo!サジェスト 30,000円~ Bingサジェスト 50,000円~ ※1キーワードあたり | 案件規模・内容により個別見積 | 要問合せ | 内容・規模により個別見積 | 案件ごとにより異なる | 案件内容に応じて個別見積 | 案件内容に応じて個別見積 |

| 契約期間 | 6~12ヶ月が中心(案件ごとに調整可) | 案件ごとに調整可能 | 要問合せ | 案件ごとにより異なる | 案件ごとにより異なる | 案件内容に応じて個別見積 | 案件内容に応じて個別見積 |

| 詳細ページ | 詳細はこちら | 詳細はこちら | 詳細はこちら | 詳細はこちら | 詳細はこちら | 詳細はこちら | 詳細はこちら |

| 公式サイト | 公式サイトはこちら | 公式サイトはこちら | 公式サイトはこちら | 公式サイトはこちら | 公式サイトはこちら | 公式サイトはこちら | 公式サイトはこちら |

著作権侵害を防ぐ最も確実な方法は、生成の根拠となる資料を自分自身で用意したソースに限定することです。

著作権侵害を防ぐ最も確実な方法は、生成の根拠となる資料を自分自身で用意したソースに限定することです。